Tesla đã tiết lộ siêu máy tính mới của họ dựa trên GPU NVIDIA A100, mạnh thứ 5 trên thế giới và nó sẽ là tiền thân của một cụm siêu máy tính Dojo mới sắp ra mắt của Tesla.

Hiện hệ thống này đang được sử dụng để đào tạo Mạng thần kinh cung cấp sức mạnh cho nền tảng Autopilot của Tesla và hệ thống tự lái bằng AI sắp tới.

Trong vài năm vừa qua, Tesla rõ ràng đã tập trung vào sức mạnh điện toán cả bên trong và bên ngoài những chiếc xe của họ.

Ở bên trong, chúng cần một máy tính đủ mạnh để chạy phần mềm tự lái, và bên ngoài, chúng cần đến hệ thống siêu máy tính để đào tạo phần mềm tự lái được xây dựng bởi các Mạng thần kinh và được “nạp” vào một lượng lớn dữ liệu đến từ toàn bộ đội xe đang vận hành trên đường.

CEO Elon Musk đã “úp mở” về dự án Dojo của Tesla, mà có vẻ như sẽ bao gồm một siêu máy tính có năng lực ở cấp độ exaFLOP, 1 quintillion (10 lũy thừa 18) floating-point operations per second, hoặc 1.000 petaFLOPS – giúp nó trở thành một trong những hệ thống máy tính mạnh nhất trên thế giới.

Tesla đã triển khai Dojo trong vài năm gần đây và Musk ám chỉ rằng nó sẽ sẵn sàng để thực thi nhiệm vụ vào cuối năm nay.

Nhưng thực sự thì hãng cũng đã phát triển các siêu máy tính khác trước khi đến với Dojo. Andrej Karpathy, người đứng đầu bộ phận AI của Tesla, đã vừa công bố hệ thống mới nhất trong một bài thuyết trình tại sự kiện “2021 Conference on Computer Vision and Pattern Recognition”.

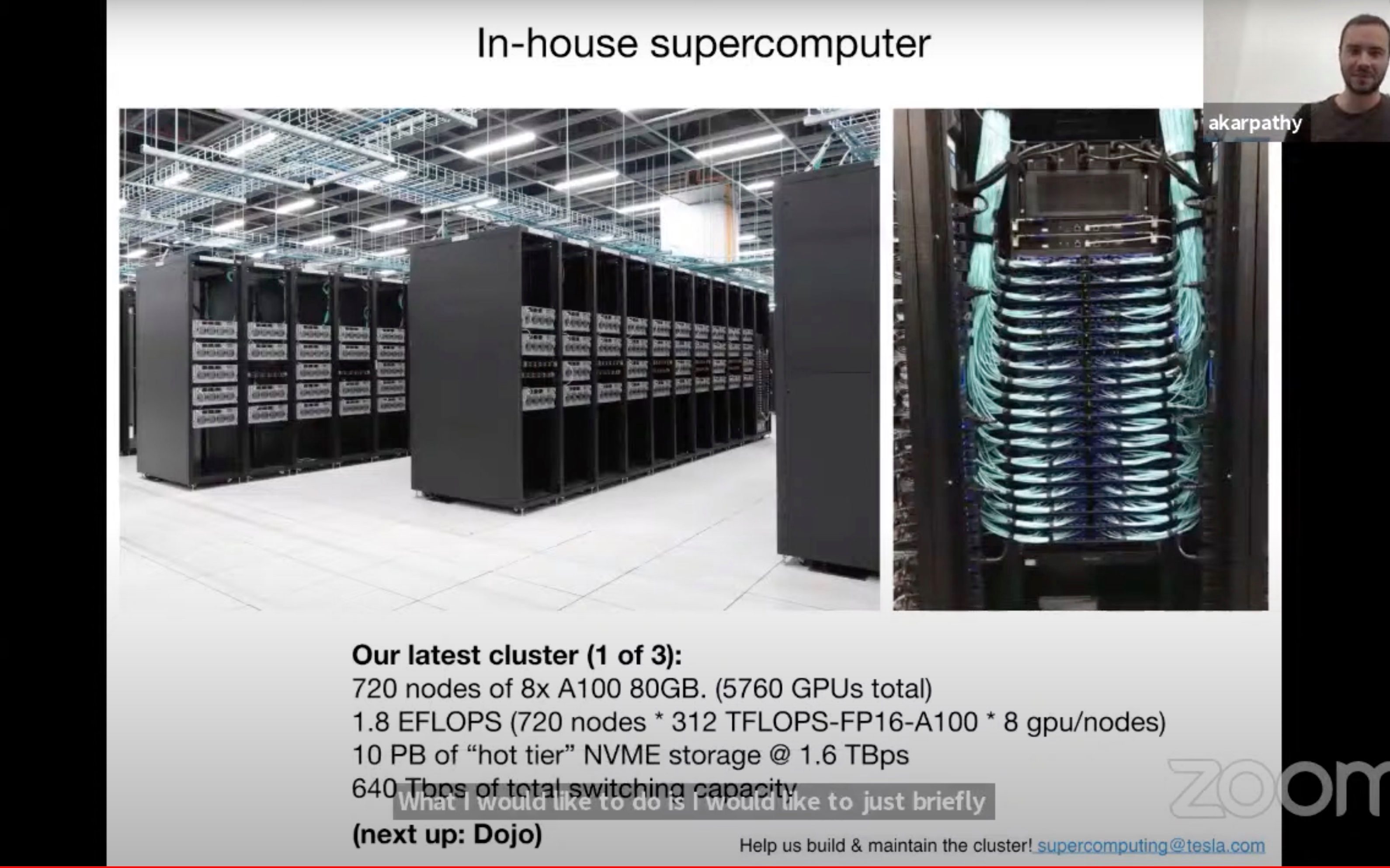

Trong buổi thuyết trình, Karpathy đã gửi lời cảm ơn tới đội ngũ triển khai siêu máy tính của Tesla và giới thiệu tác phẩm mới nhất của họ, cụm siêu máy tính thứ ba của Tesla:

Tesla đã tuyên bố một số thông số kỹ thuật khá “khủng” của cụm siêu máy tính mới này, điều này sẽ biến nó trở thành hệ thống máy tính mạnh thứ năm trên thế giới:

- 720 node với 8 x A100 80GB mỗi node (Tổng cộng có 5760 GPU!)

- 1.8 EFLOPS (720 nodes * 312 TFLOPS-FP16-A100 * 8 GPU/node)

- 10 PB bộ nhớ NVME “hot tier” @ 1,6 TBps

- 640 Tbps tổng băng thông chuyển mạch

Karpathy nhận xét về các nỗ lực này:

“Chúng tôi có một mạng lưới kiến trúc neural net và chúng tôi có một tập dữ liệu, một tập dữ liệu 1,5 petabyte đòi hỏi một quy mô hệ thống máy tính khổng lồ. Vì vậy, tôi muốn “cắm nguồn” cho cỗ máy chúng tôi đang xây dựng này và sử dụng chúng ngay bây giờ. Đối với chúng tôi, Computer Vision là vấn đề cốt lõi cho những gì chúng tôi đang làm và cho phép khả năng Autopilot. Và để điều đó hoạt động thực sự tốt, chúng tôi cần phải nắm chắc dữ liệu từ đội xe trên đường và đào tạo các mạng lưới thần kinh khổng lồ với rất nhiều thử nghiệm. Vì vậy, chúng tôi đã đầu tư rất nhiều vào nền tảng điện toán. Ở đây, chúng tôi có một cụm đã xây dựng với 720 node với 8x A100 GPU phiên bản 80GB. Đây là một siêu máy tính cực lớn. Tôi thực sự nghĩ rằng nếu xét về FLOPS, nó gần như là siêu máy tính đứng thứ 5 trên thế giới. ”

Kỹ sư Tesla không muốn nói chi tiết về dự án Dojo, nhưng anh ấy nói rằng nó thậm chí sẽ là một siêu máy tính còn tốt hơn, được tối ưu hóa cho đào tạo mạng thần kinh hơn so với cụm hiện tại của Tesla.

Musk trước đây từng đề cập rằng Tesla có kế hoạch để cuối cùng sẽ cung cấp siêu máy tính của mình cho các công ty khác để họ đào tạo mạng lưới thần kinh của họ trên đó.

Dưới đây là bài thuyết trình của Karpathy tại CCVPR 2021:

Bài viết liên quan

- Máy chủ Supermicro X14: Hiệu suất mạnh mẽ, hiệu quả tối đa cho AI, Cloud, Storage, 5G/Edge

- NVIDIA Omniverse ft Apple Vision Pro: Mở rộng thế giới quan với VR/AR

- Tôi có cần CPU kép không?

- NVIDIA NIM: Vi dịch vụ suy luận tối ưu hóa cho triển khai mô hình AI quy mô lớn

- NVIDIA HGX AI Supercomputer: Nền tảng điện toán AI hàng đầu thế giới

- NVIDIA SuperPOD DGX GB200: Kỷ nguyên của AI nghìn tỷ tham số