Ban đầu, chúng tôi muốn khám phá một quan điểm phổ biến rằng lưu trữ cục bộ ảnh hưởng đến hiệu suất của các mô hình AI. Chúng tôi lấy một trong các máy chủ Dell EMC PowerEdge R740xd trang bị cấu hình với hai CPU Intel Xeon Gold 6130 với 256GB DRAM. Chúng tôi chạy thử nghiệm byteLAKE AI bằng ba phương án lưu trữ cục bộ khác nhau. Để thử nghiệm, chúng tôi sử dụng ổ SSD KIOXIA PX04S cùng với các ổ lưu trữ Samsung 983 ZET và Intel Optane 900P có tốc độ nhanh hơn nhiều .

Trong quá trình đo benchmark, chúng tôi phân tích hiệu suất của quá trình đào tạo AI. Trong các bài kiểm tra, chúng tôi chạy quá trình học tập cho một kịch bản trong thế giới thực. Trong trường hợp này, các bài kiểm tra là một phần của quy trình đào tạo trong một trong các sản phẩm byteLAKE: EWA Guard . Nó dựa trên YOLO (You Only Look Once) mới nhất, một mô hình phát hiện thời gian thực tiên tiến nhất. Mô hình này bao gồm một input layer duy nhất, 22 convolution layers, 5 pooling layers, 2 router layers, một reorg layer và một detection layer duy nhất.

Là một thước đo cơ bản về hiệu suất, chúng tôi đã sử dụng thời gian thực hiện đào tạo cho 5000 epoch. Các bài benchmark được lặp lại ba lần cho mỗi cấu hình lưu trữ và các giá trị trung bình được trình bày bên dưới.

Các kết quả:

- KIOXIA 98h 24m

- Samsung 98h 44

- Intel 98h 42

Như rõ ràng trong số liệu kết quả, lưu trữ cục bộ không có tác động trong hiệu suất. Thử nghiệm dao động từ SATA SSD đến Optane mới nhất và lớn nhất, không có tác động gì. Điều đó nói rằng, lưu trữ có thể đóng một vai trò quan trọng hơn khi nói đến việc xâm nhập và lấy ra dữ liệu, nhưng xử lý cho AI, trong trường hợp này không có tác động.

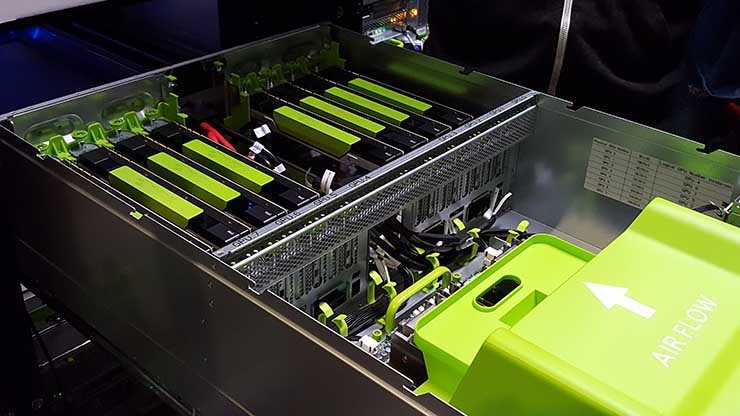

Tác động của GPU và lưu trữ đến AI

Với dữ liệu lưu trữ trong tay, chúng tôi đã thêm một NVIDIA T4 vào PowerEdge để đánh giá tác động của GPU đối với AI. Đối với thử nghiệm này, chúng tôi cũng đã chạy ba cấu hình lưu trữ tương tự.

Các kết quả:

- KIOXIA 4h 30

- Samsung 4h 28m

- Intel 4h 27m

Đúng như dự đoán, GPU đã tạo ra tác động lớn, thực tế là nó có tác động theo cấp số nhân, thúc đẩy sự cải thiện lên đến 22 lần! Với việc GPU tăng tốc hiệu suất tổng thể của AI, có một số ý kiến cho rằng việc lưu trữ nhanh hơn có thể tạo ra ảnh hưởng lớn đến hiệu suất. Tuy nhiên, điều đó không đúng trong trường hợp này.

Kết luận

Trong thử nghiệm này, chúng tôi đã tìm thấy việc sử dụng các thiết bị lưu trữ nhanh hơn để không cải thiện hiệu suất học tập. Lý do chính ở đây là một cấu trúc phức tạp của mô hình AI. Thời gian học dài hơn thời gian đọc dữ liệu. Nói một cách khác, thời gian học sử dụng lô hình ảnh hiện tại dài hơn thời gian cần thiết để đọc tiếp theo. Do đó, các hoạt động lưu trữ được ẩn đằng sau các xử lý AI.

Khi thêm vào NVIDIA T4, có một số ý kiến cho rằng AI xử lý nhanh hơn sẽ khiến bộ lưu trữ tạo ra ảnh hưởng đến hiệu suất. Đây không phải là trường hợp trong thử nghiệm này, vì ngay cả với T4, mô hình AI vẫn có thành phần học tập nặng hơn và không yêu cầu lưu trữ phải đặc biệt nhanh.

Mặc dù cần phải làm nhiều việc hơn để kiểm tra thêm tác động của các thành phần và hệ thống cụ thể đối với AI, chúng tôi tin rằng dữ liệu ban đầu này hữu ích và là điểm khởi đầu tốt cho câu chuyện. Chúng tôi cần dữ liệu ứng dụng để có thể hiểu rõ hơn về vị trí của đòn bẩy phù hợp từ quan điểm CNTT và nơi chi tiêu ngân sách có thể mang lại kết quả có ảnh hưởng nhất. Điều này tất nhiên phụ thuộc phần lớn vào nơi hoạt động này diễn ra, có thể là trong trung tâm dữ liệu hoặc cạnh biên. Hiện tại, chúng tôi hoan nghênh sự tham gia của byteLAKE ở phía dẫn đầu AI để giúp cung cấp dữ liệu hữu ích nhằm giúp trả lời những câu hỏi cấp bách này.

Đây là thử nghiệm AI đầu tiên của chúng tôi nhưng không phải là lần cuối cùng. Mariusz Kolanko, đồng sáng lập của byteLAKE, cho biết họ đã được làm việc trên một sản phẩm mang tên CFD Suite (AI cho Computational Fluid Dynamics “CFD” để tăng tốc giải quyết vấn đề), nơi quá trình học tập sâu cần rất nhiều dữ liệu cho mỗi giai đoạn đào tạo. Trên thực tế, mô hình này có thể đặt tải cao hơn cho việc lưu trữ để đào tạo các mô hình trong khu vực Big Data và có thể có tác động đến hiệu suất của chính các quy trình học sâu. Cuối cùng, như với bất kỳ ứng dụng nào, điều quan trọng là phải hiểu ứng dụng cần gán tài nguyên trung tâm dữ liệu phù hợp. AI rõ ràng không phải là dạng “one-size-fit-all” với tất cả các ứng dụng.

Theo StorageReview

Bài viết liên quan